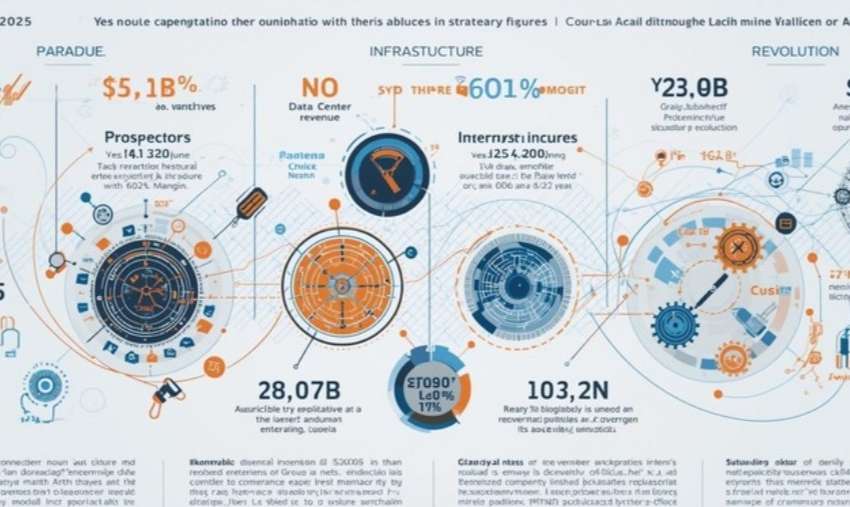

1. Cadre conceptuel. L’interopérabilité stablecoins-RWA comme condition sine qua non du scaling de la finance parallèle

L’interopérabilité entre stablecoins (USDT/USDC dominance >85 % du marché, MC ~300 Md$ au 27/03/2026) et RWA tokenisés (TVL distribuée ~26,63 Md$ ex-stablecoins, rwa.xyz) constitue le pont programmable entre liquidité fiat-native et actifs réels fractionnables. Elle transforme les stablecoins…